La Importancia del ETL en Python

El proceso ETL en Python fue diseñado para blindar la calidad del dato ante los errores encontrados en los archivos crudos. Este flujo asegura que los datos que llegan a Power BI y SQL sean "Golden Records".

Proyecto centrado en UBI-Games, plataforma con datos simulados de Ubisoft. Transformación de datos crudos en Golden Records para la toma de decisiones estratégicas.

La organización busca proyecciones basadas en datos con un objetivo crítico: atraer nuevos inversores y consolidar alianzas estratégicas.

La dirección de la empresa carece de conocimientos técnicos, por lo que se requiere transformar datos crudos en un análisis visual, claro y estratégico.

No basta con mostrar tablas; se deben responder preguntas sobre el comportamiento del usuario, la rentabilidad de los juegos y la actividad en la plataforma para facilitar la toma de decisiones.

El proyecto utiliza registros simulados basados en títulos reales de Ubisoft, modelando la interacción completa:

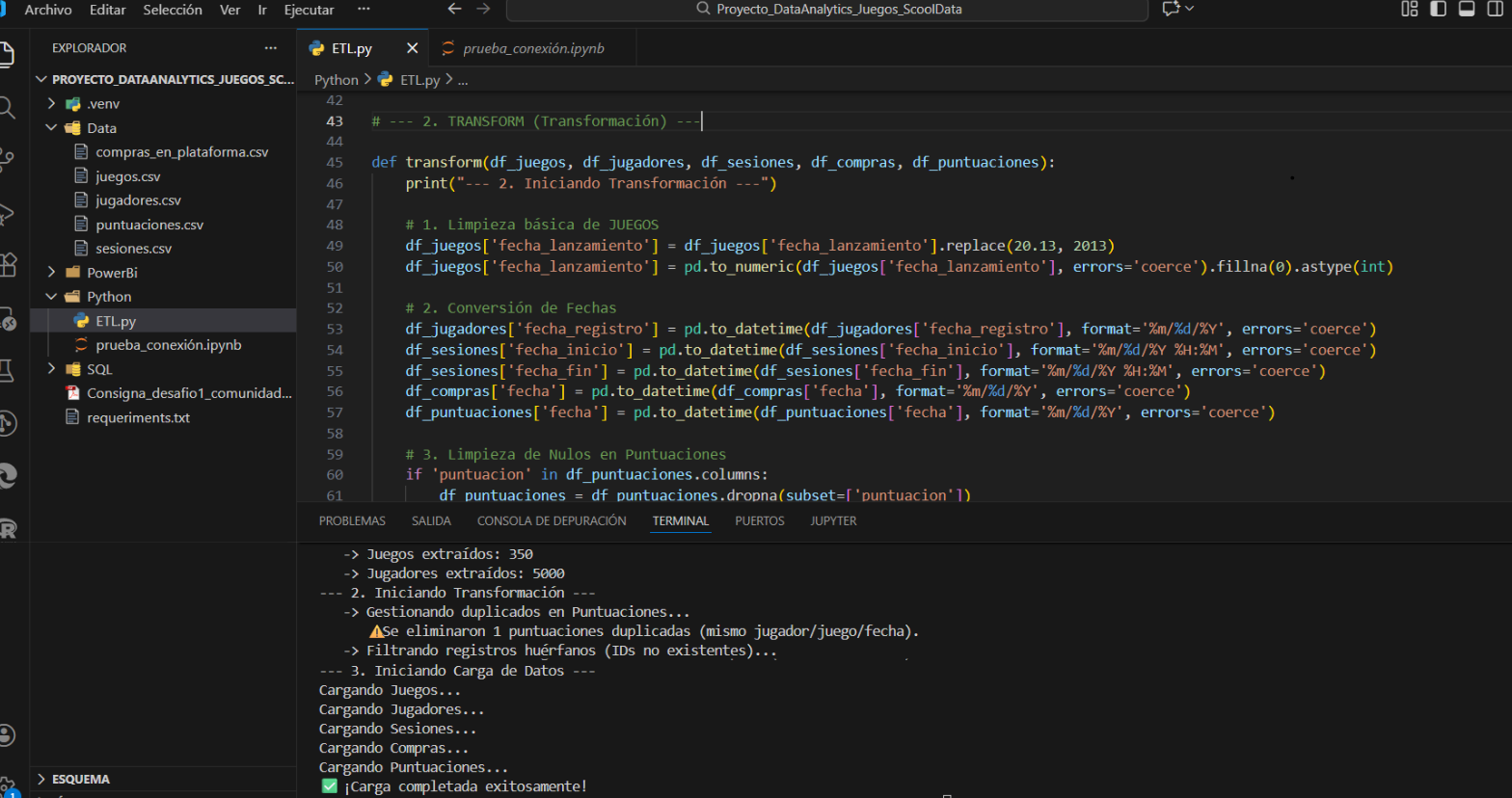

El proceso ETL en Python fue diseñado para blindar la calidad del dato ante los errores encontrados en los archivos crudos. Este flujo asegura que los datos que llegan a Power BI y SQL sean "Golden Records".

Snippet del proceso de limpieza con Pandas

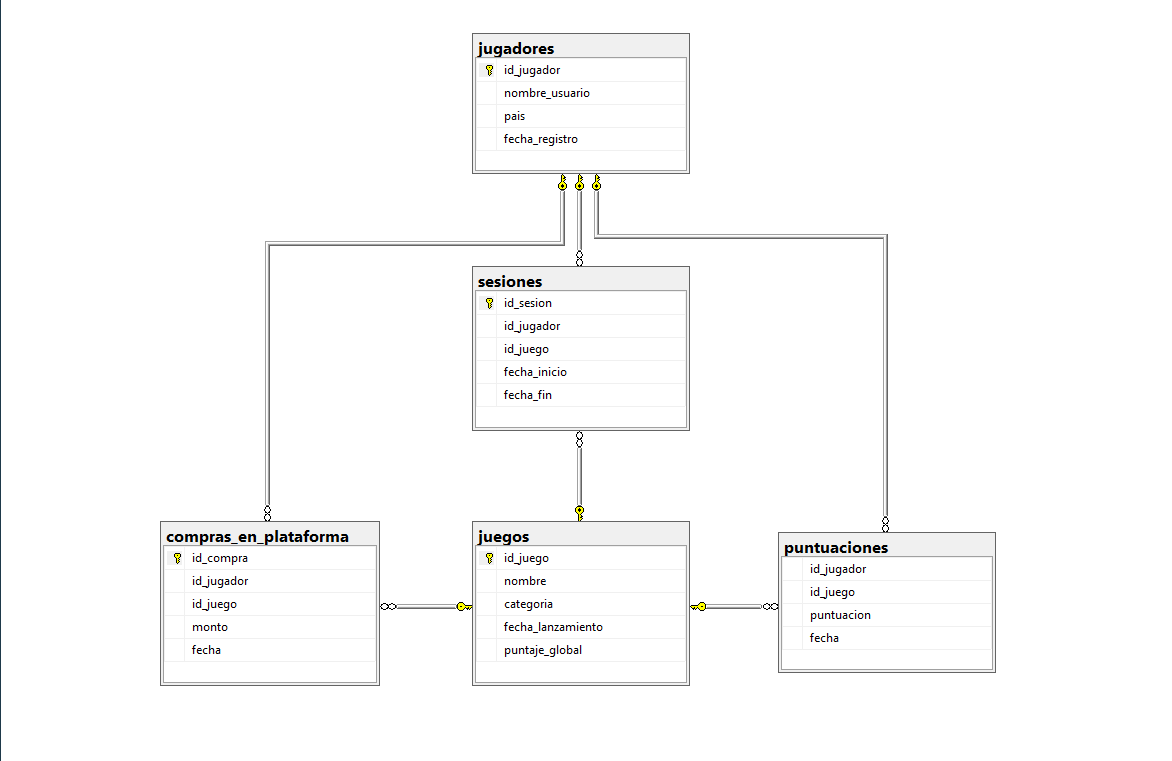

Transformación de archivos planos desconectados en un modelo relacional robusto.

Esquema Relacional Optimizado

Las consultas SQL no son aleatorias; responden directamente a las métricas sugeridas por la gerencia para la atracción de inversores.

Cruzamos las dimensiones de calidad, ventas y tiempo para generar hipótesis sobre "baja puntuación" y detectar éxitos comerciales que podrían ser fracasos en calidad.

Permite saber qué género financia a la compañía.

Segmentación de clientes VIP por actividad.

Ingreso promedio por usuario activo cruzado por zona.

Días y horarios de mayor actividad para optimización.

Organización modular lista para producción y escalabilidad.

Script principal de orquestación. Extrae, Transforma y Carga (Load) hacia SQL Server.

Definición del esquema, creación de tablas, llaves primarias y foráneas.

Ingesta de múltiples fuentes CSV simuladas (Catalog, User, Stream, etc.).

Queries de negocio optimizadas para responder las preguntas de la gerencia.